Než začnete s instalací vLLM, vyplatí se vědět, proč jsou naše AI/GPU servery vhodnou platformou pro produkční inferenci, testování open-source modelů i provoz vlastního AI API.

AI/GPU server si objednáte priamo na stránke služby, kde zvolíte vhodnú konfiguráciu a dokončíte objednávku. Pokiaľ hľadáte ideálne riešenie pre vLLM a rozsiahlejšie LLM modely, odporúčame zvoliť variantu s NVIDIA RTX PRO 6000 Blackwell.

Po dokončení objednávky a úspešnej platbe obdržíte e-mail s prihlasovacími údajmi. Akonáhle sa pripojíte k serveru, môžete okamžite začať s prípravou prostredia pre AI inference server.

Presvedčte sa sami o sile najvýkonnejších AI GPU na trhu.

Otestujte AI VPS a plaťte až po vyskúšaní.

Každý AI/GPU server je pripravený tak, aby ste mohli oddeliť systémové súbory od dát pre modely a cache. Systémový disk má kapacitu 150 GB, zatiaľ čo dátový disk ponúka 2 TB a je pripojený ako /data.

Práve do umiestnenia /data odporúčame ukladať virtuálne prostredie, stiahnuté modely, Hugging Face cache a ďalšie objemnejšie súbory. Získate tak viac priestoru pre dlhodobú prevádzku a zároveň nepreťažíte systémový disk.

vLLM je výborná voľba pre každého, kto chce prevádzkovať AI modely efektívnejšie, rýchlejšie a s lepšou obsluhou viac požiadaviek naraz. Nižšie nájdete kompletný postup, ako pripraviť server, nainštalovať potrebné nástroje a spustiť prvé API endpoint pre inference.

Najprv aktualizujte balíčky a nastavte oprávnenia k dátovému disku. Tým si pripravíte prostredie, do ktorého budete ukladať cache, virtuálne prostredie aj modely pre vLLM.

sudo apt update

sudo chown vpsuser:vpsuser /dataAby vLLM využilo výkon GPU naplno, je nutné doinštalovať aktuálny NVIDIA CUDA Toolkit. Nižšie uvádzame príklad pre Ubuntu 24.04, ale počítajte s tým, že sa inštalačné príkazy môžu v čase meniť podľa verzie systému alebo CUDA balíčkov.

Pokiaľ by niektorý príkaz prestal fungovať, otvorte stránku NVIDIA CUDA Downloads a vygenerujte si aktuálny postup pre vaši konfiguráciu systému.

wget https://developer.download.nvidia.com/compute/cuda/repos/ubuntu2404/x86_64/cuda-keyring_1.1-1_all.deb

sudo dpkg -i cuda-keyring_1.1-1_all.deb

sudo apt-get update

sudo apt-get -y install cuda-toolkit-13-2Následně vytvoříme samostatné Python virtuální prostředí na datovém disku. Díky tomu zůstane instalace přehledná, snadno přenosná a nebude zbytečně zatěžovat systémovou část serveru.

sudo apt install -y python3-pip python3.12-venv

python3 -m venv /data/vllm-py

source /data/vllm-py/bin/activate

pip install vllmPo dokončení inštalácie budete mať pripravené prostredie pre spustenie vLLM servery aj ďalších knižníc podľa potreby.

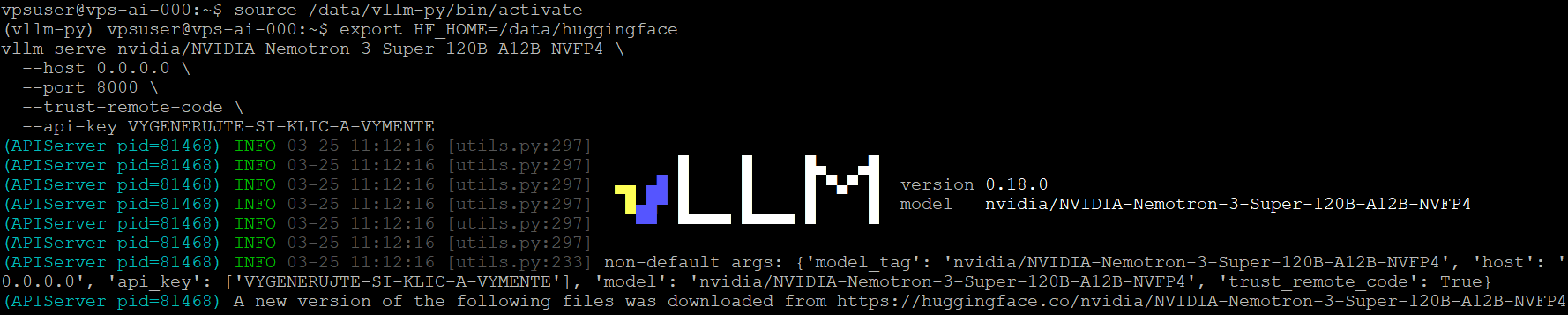

Pred samotným spustením odporúčame nastaviť cache pre Hugging Face modely na dátový disk. Zabránite tým plneniu systémového úložiška a zároveň budete mať všetky veľké súbory prehladne uložené na jednom mieste.

API kľúč si môžete jednoducho vygenerovať pomocou tr -dc 'A-Za-z0-9' </dev/urandom | head -c 32; echo a následne ho vložiť do príkazu namiesto VYGENERUJTE-SI-KLUC-A-VYMENTE.

Nižšie uvedený príklad spúšťa model NVIDIA Nemotron 120B, ktorý dobre ukazuje, aký potenciál majú servery s 96 GB VRAM a profesionálny Blackwell grafikou pre rozsiahlejšie inference workloady.

export HF_HOME=/data/huggingface

vllm serve nvidia/NVIDIA-Nemotron-3-Super-120B-A12B-NVFP4 \

--host 0.0.0.0 \

--port 8000 \

--trust-remote-code \

--api-key VYGENERUJTE-SI-KLUC-A-VYMENTEPo spustení začne vLLM pripravovať model pre inference. Doba prvého načítania závysí na konkrétnom modele a môže trvať až niekoľko minút.

Akonáhle vLLM beží, otvorte si druhú konzolu a vykonajte test API. V ukážke nižšie nahraďte hodnotu VYGENERUJTE-SI-KLUC-A-VYMENTE vlastným kľúčom, ktorý ste nastavili v predchádzajúcom kroku.

Pri prvej požiadavke počítajte s tým, že model môže približne 10 sekúnd inicializovať odpoveď. Ďalšie requesty už bývajú rýchlejšie a čas zaberie prevážne samotné generovanie výstupu.

curl -sS http://localhost:8000/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer VYGENERUJTE-SI-KLUC-A-VYMENTE" \

-d '{

"model": "nvidia/NVIDIA-Nemotron-3-Super-120B-A12B-NVFP4",

"messages": [

{"role": "user", "content": "Say hello and confirm you are working."}

],

"max_tokens": 1000

}' | jq -r '.choices[0].message.content'Pokiaľ sa vráti textová odpoveď modelu, máte hotovo a váš vLLM inference server je pripravený pre ďalšie integrácie, automatizáciu aj napojenie na vlastné aplikácie.

AI/GPU server s výkonnou grafikou nevyužijete len pre jeden konkrétny model. Akonáhle máte pripravené vLLM alebo iné inference prostredie, môžete server nasadiť aj pre ďalšie AI scenáre a firemný use-case.

Vďaka tejto flexibilite získate univerzálnu GPU infraštruktúru, ktorú ľahko prispôsobíte vývoju, testovaniu aj produkčnej prevádzke.

AI/GPU server s NVIDIA RTX PRO 6000 Blackwell predstavuje rýchle a praktické riešenie pre každého, kto chce rozbehúť vLLM, prevázdkovať vlastný inference endpoint a využiť vysoký výkon GPU bez zriaďovania drahého fyzického hardware.

Napíšte nám a pripravíme vám vhodné riešenie pre rýchle nasadenie vLLM, veľkých jazykových modeloch aj vlastné AI API.